AIが「自分の声で歌う」時代が来た。

Sunoは2026年3月26日、v5.5をリリースした。今回のアップデートの核心は「Voices」「Custom Models」「My Taste」の3機能だ。これまでのAI音楽生成は「どんな曲でも作れるが、自分らしくない」という問題があった。v5.5はその限界に正面から向き合っている。

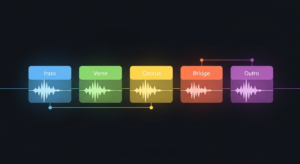

3つの新機能:何ができるようになったか

Voices──自分の声でAIに歌わせる

Sunoに自分の声を登録すると、AIがその声のモデルを作成し、以降の楽曲生成でその声を使えるようになる。ボイスキャプチャ時には本人確認として「話し声と歌声の一致検証」が行われる。

重要なのは声のデータは本人のみが使えるという設計だ。他のユーザーが自分の声を無断で使うことはできない。将来的には声の共有機能が実装予定とされているが、制御権は作成者が保持する。

Custom Models──自分の楽曲スタイルを学習させる

過去に作った楽曲をアップロードすると、自分のスタイルを学習した「パーソナルモデル」が構築される。Pro・Premierユーザーは最大3つのカスタムモデルを作成でき、6曲以上のアップロードから開始できる。

「自分のスタイルをAIに引き継ぐ」という発想は、ミュージシャンにとって新しいワークフローを意味する。新曲のスケッチをカスタムモデルで生成し、そこにVoicesで自分の声を乗せる──という使い方が現実的なラインとして見えてくる。

My Taste──使うほどAIが自分に近づく

Sunoを使い続けることで、AIがユーザーの好みのジャンル・ムード・スタイルを学習していく機能。こちらは全プランで利用可能。細かいプロンプト設計が不要になり、「自分向けにチューニングされたSuno」として機能し始める。

対象プランと制限

Pro(月額$8)、Premier(月額$24)のみが主要機能の対象になる点は注意が必要だ。無料プランでは試せない。

ミュージシャンにとっての実用的な使い方

v5.5の価値は「AIで音楽を作る」から「AIで自分らしい音を作る」へのシフトにある。具体的には以下のような活用シーンが考えられる。

デモ制作の効率化

サビのメロディーとコードを決めたら、カスタムモデルで自分のスタイルに近いアレンジを複数パターン生成し、その中から選ぶ。従来のDAW作業に「アイデア出し」のレイヤーを追加する使い方。

ボーカルプロトタイプ

Voicesで自分の声を使ってメロディーラインを仮置きし、最終的に本録音に差し替える。音程確認・アレンジ判断を自分の声感覚で行えるのは大きい。

BGM・サブスクリプション用コンテンツ

自分のスタイルを維持しながら量産したい場合、カスタムモデルは効率的だ。ただし配信プラットフォームのAI楽曲ポリシーは別途確認が必要(後述)。

注意点:配信・著作権のリスク

Suno v5.5で生成した楽曲を商業配信する場合、いくつかの落とし穴がある。

TuneCoreは100%AI生成楽曲を拒否している(→ 関連記事参照)。DistroKidなどの他社でも審査が厳格化している。カスタムモデルで自分のスタイルが入っていても「AI生成楽曲」と判断される可能性は高い。

また、Voices機能でアップロードした自分の声が学習データとしてSuno側に保持されるかどうか、プライバシーポリシーの確認も欠かせない。

v5.5が示す方向性

SunoのCEOは「最高の音楽は人間から始まる」というコンセプトをv5.5のビジョンとして掲げた。AIが自分の声・スタイル・好みを学ぶ仕組みは、「AIを使うミュージシャン」ではなく「AIがミュージシャンの延長になる」という方向性だ。

日本のAIクリエイターコミュニティでも、リリース直後から反応が広がった。

📕Suno v5.5が出た。聴いた瞬間、声が出たよ

新機能を3つ並べてみる

・自分の声を登録して、AIにその声で歌わせられる(Voices)

・自分の過去曲をアップして、自分のスタイルを学習させられる(Custom Models)

・使えば使うほど、自分の好みに合わせてAIが進化する(My Taste)… https://t.co/u3LPG8OoUA pic.twitter.com/4Q33doZ8kp— テツメモ|AI図解×検証|Newsletter (@tetumemo) March 27, 2026

「聴いた瞬間、声が出た」という第一印象が示すのは、今回の変化が「スペック上の改善」ではなく「体感として別物」だということだ。Voices・Custom Models・My Tasteをセットで使うことで、v5.5は初めてミュージシャンの「第2のDAW」として機能し始める。ただし、配信とロイヤルティの問題が整理されないままでは、どれだけ表現が豊かになっても収益化の壁は残る。v5.5の新機能を試しながら、配信ルールの変化も同時に追っておく必要がある。

参考URL: https://suno.com/blog/v5-5

コメント